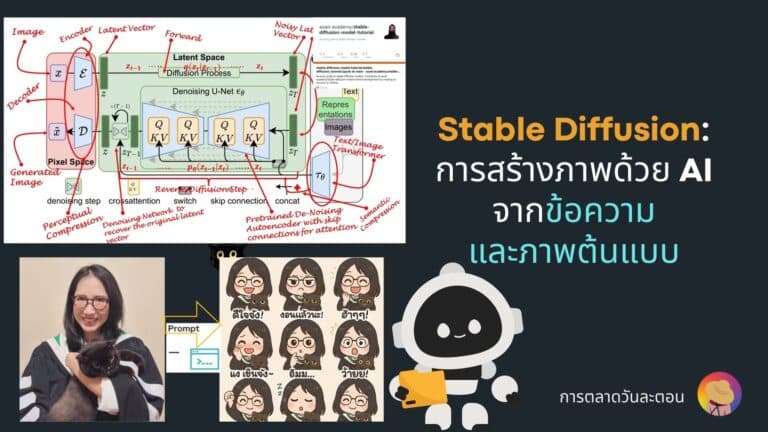

Stable Diffusion: การสร้างภาพด้วย AI จากข้อความและภาพต้นแบบ

สวัสดีค่ะทุกท่าน )ヽ(✿゚▽゚)ノ ในช่วงสัปดาห์ที่ผ่านมามีการถกกันในประเด็นที่นับว่าน่าสนใจมากๆ ในโลกยุคดิจิทัลที่เทคโนโลยีสามารถเลียนแบบศิลปะได้ใกล้เคียงความจริงมากกว่าที่เคย นั่นคือปรากฏการณ์ที่ AI สามารถสร้างภาพลายเส้นในสไตล์ Studio Ghibli (จิบิ, ちび) ได้อย่างแนบเนียนสุดๆ เพียงแค่พิมพ์ข้อความ ซึ่งทำให้ Generative AI กลายเป็นทั้งเครื่องมือแห่งความคิดสร้างสรรค์ และจุดเริ่มต้นของคำถามเชิงจริยธรรมที่สะท้อนถึง “ตัวตนของงานศิลปะ” อย่างลึกซึ้ง โดยเบื้องหลังของ AI Model ที่ใช้สร้างภาพเหล่านี้มีทั้ง DALL-E จาก OpenAI, Stable Diffusion หรือโมเดลอื่นๆ จากหลายค่าย ทำให้เราสามารถเปลี่ยนข้อความธรรมดาร่วมกับการใช้รูปตัวอย่าง ให้กลายเป็นภาพที่มีอารมณ์และรายละเอียด คล้ายกับว่ามีศิลปินลงมือวาดเอง ซึ่งกระบวนการสร้างนี้ไม่เพียงแค่สะท้อนความก้าวหน้าทางวิทยาการ แต่ยังเปิดประเด็นทางสังคมและกฎหมายในระดับสากลเกี่ยวกับความเป็นเจ้าของ ความสร้างสรรค์ และอนาคตของศิลปะในยุคที่ “จิตวิญญาณ” อาจถูกเขียนด้วยรหัส ในบทความนี้นิกเลยอยากพาทุกท่านไปทำความเข้าใจเจาะลึกเบื้องหลังกระบวนการอันซับซ้อนของเทคโนโลยี Generative AI อัลกอริทึมแรกๆ ที่เป็นพื้นฐานของอีกหลายโมเดลในยุคนี้อย่าง Stable Diffusion ที่ใช้หลักการ “แพร่ข้อมูลแบบเสถียร” (Stable Diffusion) ผ่านโมเดล Deep Learning ที่ผสมผสานการทำงานของ […]